Nuevos límites de rastreo e indexación de Googlebot

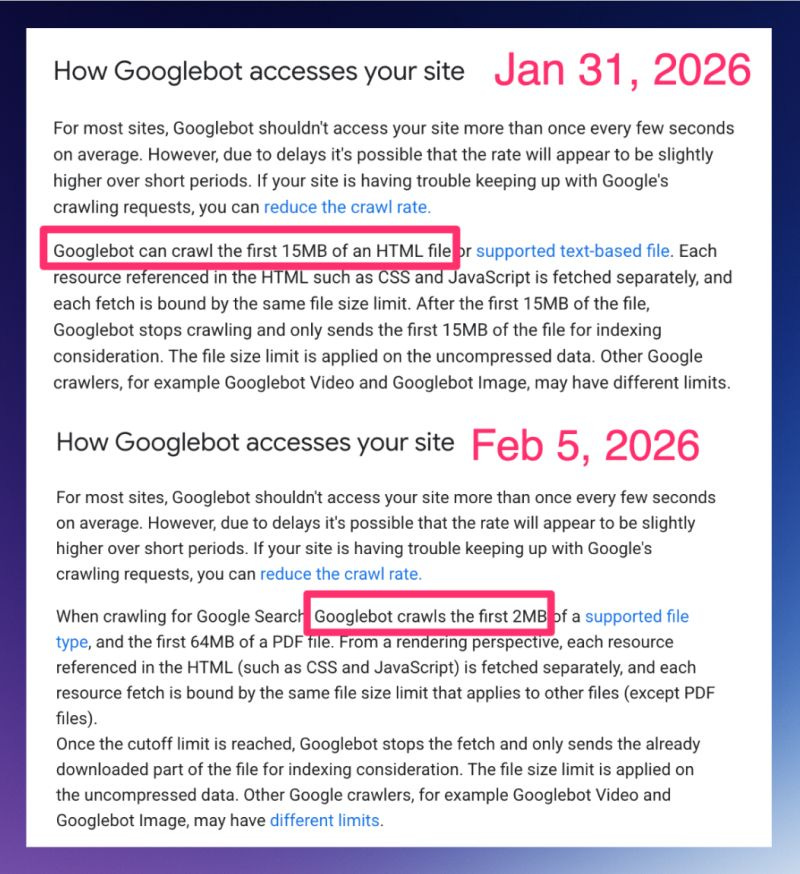

A partir de febrero de 2026, Google ha implementado un cambio drástico en la forma en que su robot (Googlebot) procesa las páginas web, reduciendo el límite de rastreo para archivos HTML de 15 MB a solo 2 MB.

Esta medida tiene consecuencias directas para cualquier sitio web que supere ese tamaño. Os explico un poco más sobre las implicaciones que tenemos entre manos.

El nuevo límite de 2 MB

Contenido invisible: Si un archivo HTML supera los 2 MB, Google dejará de leerlo al alcanzar ese límite. Todo lo que esté escrito por debajo de ese punto —texto, enlaces o palabras clave— será invisible para el buscador y no aparecerá en los resultados.

Recursos afectados: Esta restricción de 2 MB no solo se aplica al HTML, sino también a cada archivo individual de CSS, JavaScript y JSON. Si estos archivos son demasiado pesados, se cortarán y la página podría no visualizarse o funcionar correctamente para Google.

La excepción de los PDF: Los archivos PDF mantienen un límite mucho más amplio, permitiendo hasta 64 MB por documento.

¿Qué impacto tiene en la mayoría de webs?

Aunque el recorte es del 86,7%, la mayoría de las páginas web estándar no deberían verse afectadas de inmediato, ya que el tamaño medio de un HTML suele rondar los 30 KB. Sin embargo, las páginas con mucho código, listados de productos infinitos o scripts pesados corren un riesgo serio.

Recomendaciones para no perder visibilidad

Para asegurar que Google siga leyendo todo el contenido de tu web, te recomiendo tomar estas medidas:

Auditar el tamaño: Comprobar que ninguna página individual supere los 2 MB de código base. Lo podéis hacer con ScreamingFrog.

Limpiar el código: Minificar y comprimir los archivos HTML, CSS y JavaScript para eliminar caracteres innecesarios. Y encima, mejoráis las Core Web Vitals.

Fragmentar recursos: En lugar de tener un único archivo de código gigante, es preferible dividirlo en varios más pequeños. Más escalable y operativo.

Siempre he dicho que para Google rastrear e indexar las páginas supone un coste y siempre está buscando maneras de ahorrar; ahora parece que pone el foco en evitar procesar archivos excesivamente pesados que ralentizan su infraestructura.